Die EU hat mit dem AI Act das erste umfassende KI-Gesetz der Welt verabschiedet. Das klingt nach einer Führungsrolle. Aber während Brüssel reguliert, investieren die USA Milliarden und China skaliert in einem Tempo, das europäische Bürokraten schweißnasse Hände bekommen lässt. Ob die EU wirklich vorne liegt oder gerade dabei ist, das Rennen zu verlieren, erfährst du in diesem Artikel.

Infos auf einen Blick

- Der AI Act gilt seit August 2024: Das Gesetz tritt gestaffelt in Kraft. Hochrisiko-KI-Systeme müssen erst ab August 2026 vollständig konform sein. Bis das Regelwerk komplett wirkt, dauert es bis 2027.

- Die USA haben die Richtung gewechselt: Unter Trump wurde Bidens KI-Dekret von 2023 vollständig widerrufen. Die offizielle Linie lautet jetzt: Deregulierung, Dominanz, kein Kompromiss.

- Viele Unternehmen wollen eine Pause: In einem offenen Brief haben 46 führende Unternehmen die EU-Kommission gebeten, die Umsetzung des AI Acts um zwei Jahre zu verschieben. Das sagt einiges darüber aus, wie die Wirtschaft die Lage einschätzt.

Was der EU AI Act wirklich ist und was er nicht ist

Der AI Act ist ein risikobasiertes Gesetz. Das bedeutet, dass nicht jede KI-Anwendung gleich behandelt wird, sondern nach dem Risiko eingestuft wird, das sie für Menschen mit sich bringt. Anwendungen mit minimalem Risiko bleiben weitgehend unreguliert. Hochrisiko-Systeme dagegen, also etwa KI in der Personalauswahl, in der Kreditvergabe oder in der Strafverfolgung, unterliegen strengen Transparenz- und Dokumentationspflichten.

Verboten sind Anwendungen, die ein inakzeptables Risiko darstellen. Dazu zählt unter anderem das staatliche Social Scoring nach chinesischem Vorbild sowie bestimmte biometrische Überwachungssysteme im öffentlichen Raum.

Was der AI Act nicht ist, ist eine Innovationsbremse per Definition. Die Idee dahinter ist tatsächlich clever: Wer im harmlosen Bereich entwickelt, hat kaum Bürokratie zu fürchten. Wer in sensiblen Bereichen operiert, muss Verantwortung übernehmen. Das Problem liegt weniger im Konzept als in der Umsetzung. Der Digitalverband Bitkom hat es so formuliert: Wenn selbst Juristen uneins sind, wie der AI Act auszulegen ist, können Mittelständler und Entwickler keine fundierten Entscheidungen treffen.

So reguliert der Rest der Welt

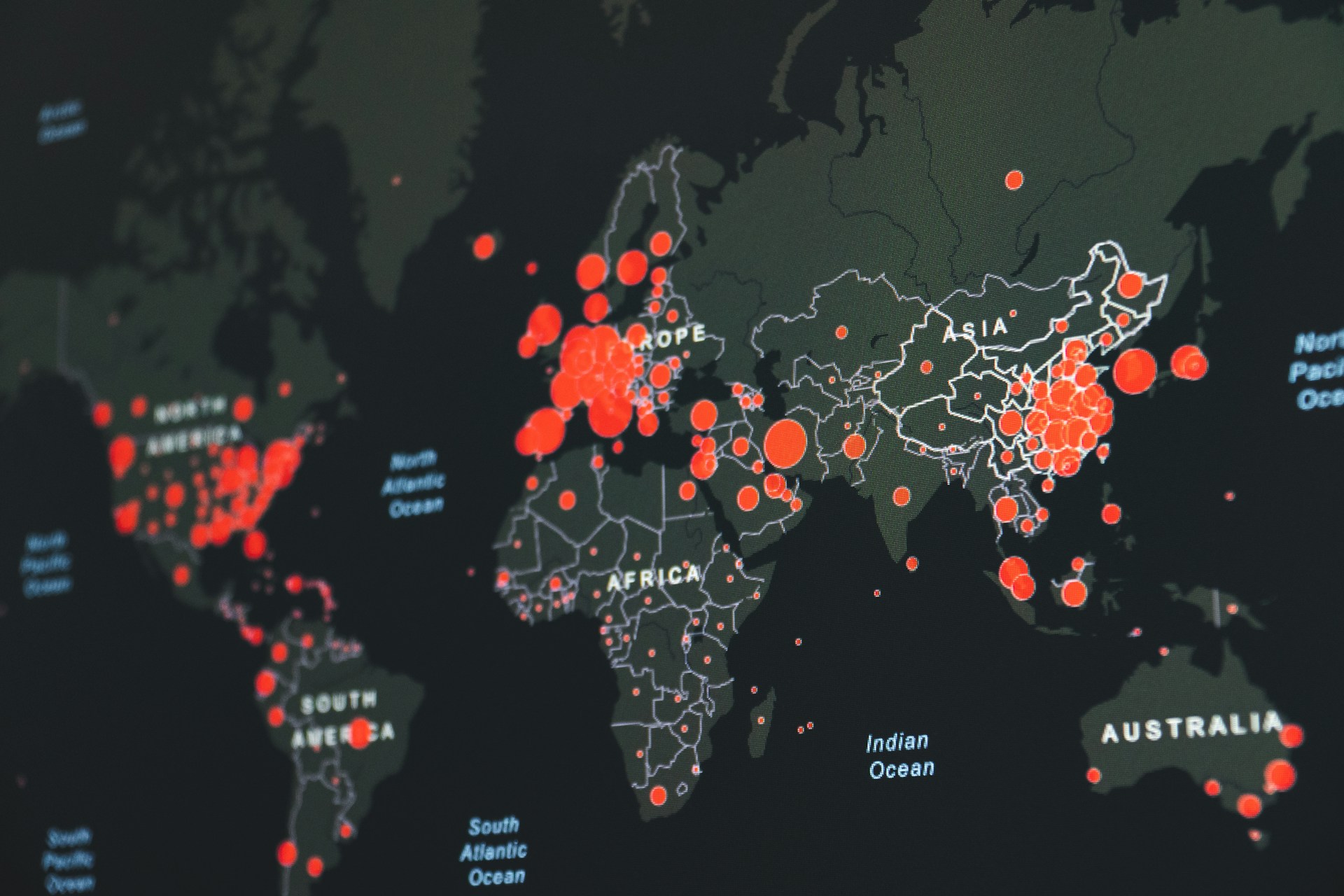

Wenn du verstehen willst, ob die EU abgehängt wird, musst du verstehen, was die anderen machen. Und da wird das Bild deutlich unbequemer.

Die drei größten Regulierungsansätze im Vergleich:

- USA: Unter Trump gilt auf Bundesebene Deregulierung als Staatsziel. Das Weiße Haus hat im Juli 2025 seinen „AI Action Plan“ vorgelegt, dessen erklärtes Ziel die globale technologische Dominanz der USA ist. Auf Einzelstaatenebene entsteht ein Flickenteppich aus unterschiedlichen Regeln, etwa in Kalifornien oder New York. Das Ergebnis ist maximale Freiheit für große Konzerne bei gleichzeitiger Rechtsunsicherheit für alle anderen.

- China: China reguliert nicht durch ein großes Gesetz, sondern durch laufend angepasste Maßnahmenpakete. Deepfake-Richtlinien, Kennzeichnungspflichten für synthetische Inhalte und klare Vorgaben, dass KI-Ausgaben mit staatlichen „Kernwerten“ kompatibel sein müssen. Die Innovationsgeschwindigkeit ist hoch, der staatliche Einfluss auf die Entwicklungsrichtung ist es ebenfalls.

- EU: Rechtlich verbindlich, risikobasiert, global beachtet. Aber langsam. Amerikanische Tech-Konzerne können neue Modelle in Wochen skalieren, während europäische Projekte oft Monate auf Genehmigungen warten.

Das Investitionsproblem ist real

Regulierung allein erklärt den Rückstand nicht vollständig. Das eigentliche Problem ist das Geld. Die EU hat für ihr „Apply AI“ Programm rund eine Milliarde Euro eingeplant. Die USA investieren allein in KI-Infrastruktur über zehn Milliarden Dollar jährlich. China ein Vielfaches davon.

Das ist kein marginaler Unterschied, das ist eine andere Gewichtsklasse. Und der deutsche KI-Forscher Kristian Kersting hat das auf den Punkt gebracht: Die Idee sei richtig, aber das Tempo sei entscheidend. Wenn zu lange geplant werde, seien die Märkte längst verteilt.

Was das für dich bedeutet: Wenn du in einem deutschen oder europäischen Technologieunternehmen arbeitest, konkurrierst du mit Unternehmen, die in einem regulatorisch entspannteren Umfeld mit deutlich mehr Kapital entwickeln. Das ist kein Weltuntergangsszenario, aber es ist eine strukturelle Benachteiligung, die man nicht wegdiskutieren kann.

Wo Europa tatsächlich vorne liegt

Es wäre unehrlich, nur die Nachteile zu benennen. Europa hat einen Vorteil, der unterschätzt wird: Vertrauen.

Während amerikanische KI-Produkte zunehmend mit Datenschutzskandalen und politischer Vereinnahmung in Verbindung gebracht werden, gilt das EU-Label für viele Unternehmen und Verbraucher weltweit als Qualitätsmerkmal. Wer ein EU-zertifiziertes KI-System nutzt, weiß, dass bestimmte Grundstandards eingehalten wurden. Das ist kein Selbstzweck, das ist ein echtes Wettbewerbsmerkmal in Märkten, in denen Datensouveränität und Compliance eine Rolle spielen.

Dazu kommt, was Juristen den „Brussels Effect“ nennen: Regulierungen der EU haben eine Tendenz, global zu wirken, weil multinationale Konzerne keine getrennten Produkte für Europa und den Rest der Welt bauen wollen. Wer den europäischen Standard erfüllt, erfüllt oft de facto einen globalen Standard. Das ist Macht durch Regulierung, und sie funktioniert.

Die eigentliche Frage: Wer definiert die Spielregeln?

Das ist der Kern der Debatte. Es geht nicht nur darum, wer die schnellste KI hat. Es geht darum, wer festlegt, nach welchen Regeln KI entwickelt und eingesetzt wird. Welche Werte in diese Systeme eingebaut sind. Und wer dafür haftet, wenn etwas schiefgeht.

Europa hat sich entschieden, diese Frage ernst zu nehmen. Die USA haben sich entschieden, sie der Industrie zu überlassen. China hat sie für den Staat reklamiert. Alle drei Ansätze haben Konsequenzen, die weit über Technologiepolitik hinausgehen.

Ob Deutschland und die EU abgehängt werden, hängt davon ab, was man unter „vorne liegen“ versteht. Bei Investitionsvolumen und Entwicklungsgeschwindigkeit: ja, im Moment. Bei der Fähigkeit, globale Standards zu prägen und Technologie mit demokratischen Werten zu verbinden: noch nicht.

Fazit: Regulierung ist kein Gegenteil von Stärke

Der AI Act ist nicht perfekt. Er ist zu langsam, zu komplex und zu schwer verständlich für Unternehmen, die eigentlich entwickeln wollen statt Formulare auszufüllen. Das sind echte Probleme, die Europa angehen muss.

Aber die Alternative, auf Regulierung zu verzichten und darauf zu hoffen, dass Konzerne es schon richtig machen, ist keine. Die nächsten zwei Jahre werden zeigen, ob Europa den AI Act so schleift, dass er Innovation ermöglicht statt verhindert. Wenn das gelingt, ist der Rückstand aufholbar. Wenn nicht, diskutieren wir das Thema in fünf Jahren auf amerikanischen oder chinesischen Plattformen.